자유게시판

하사비스 : AGI까지 큰 돌파구 1~2개만 더 뚫으면 됨.

작성자

작성일

2026-02-26 23:50

조회

475

https://sub.strongai.kr/%ec%9e%90%ec%9c%a0%ea%b2%8c%ec%8b%9c%ed%8c%90-2/?mod=document&uid=3272

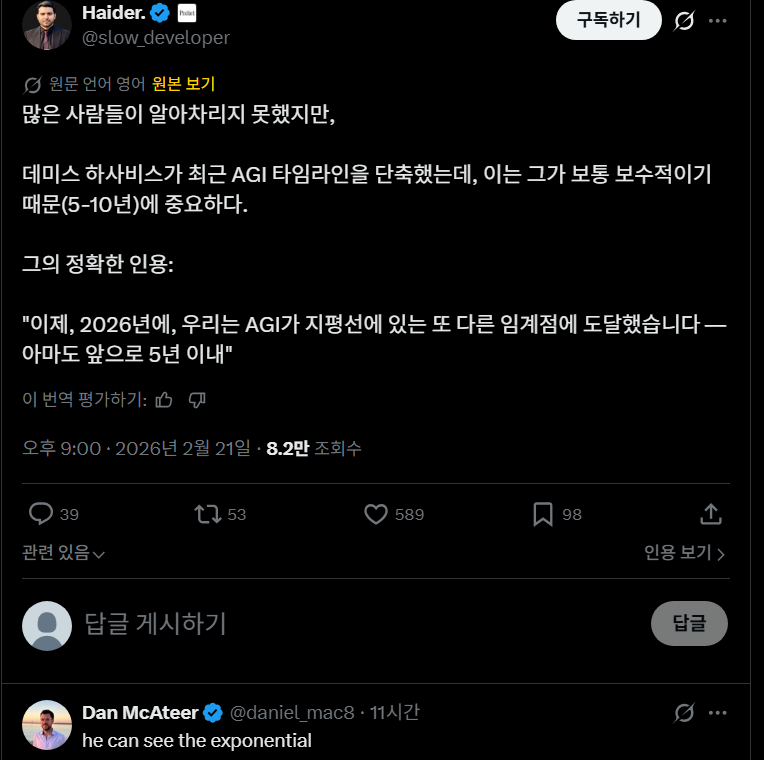

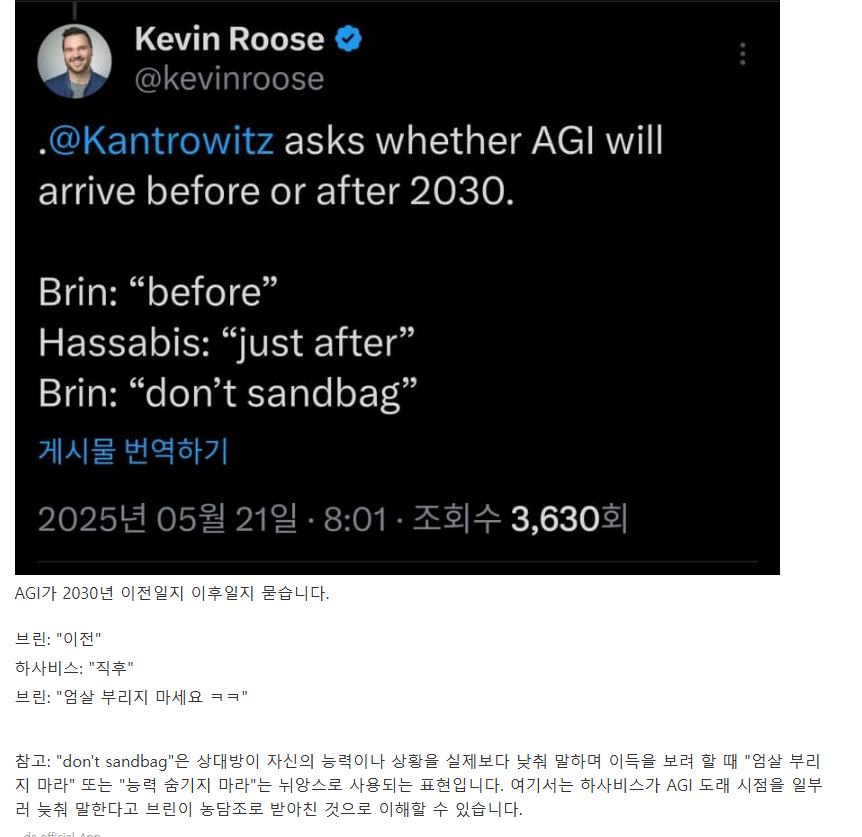

위 글은 브린이랑 대화내용에서 알수있는 하사비스 타임라인이 AGI 2030 전 이라는거

그리고 하사비스가 얼마전 (2026년 1월즘) 인터뷰한거인대

+

하지만 어느 쪽에 속하든, 최종 인공 일반 지능(AGI) 시스템의 핵심 구성 요소로서 대규모 기초 모델이 필요할 것이라는 점에는 동의합니다. 얀 르쿤처럼 기초 모델(LLM)이 막다른 길이라고 생각하는 사람의 의견에는 동의하지 않습니다.

(But I think no matter what camp you’re in, we’re going to need large foundation models as the key component of the final AGI systems. Of that, I’m sure. So I’m not a subscriber to someone like Yann LeCun, who thinks they’re just some kind of dead end. )

위 인터뷰 내용볼보면 알수있듯이

LLM 이 AGI의 토대가 될것이며 얀 르쿤처럼 벽에 막혔다는 의견에 동의 안 함. ( "그 고양이 지능" ㅋㅋ )

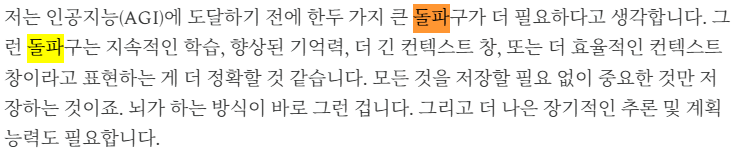

AGI 도달하기위해 돌파구가 1~2개가 필요하다고함(!!)

그러니 남아있는 큰 벽이 사실상 1~2개 밖에없다고 보는 입장임 (지속학습, 향상된 기억력 (장기기억) , 더 긴 컨텍스트 창 (Efficient Context) )

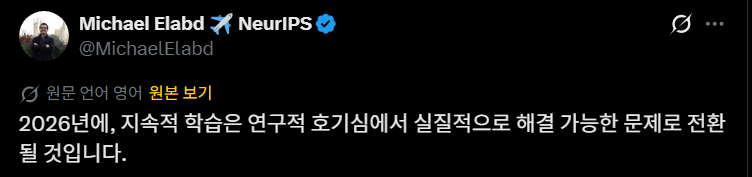

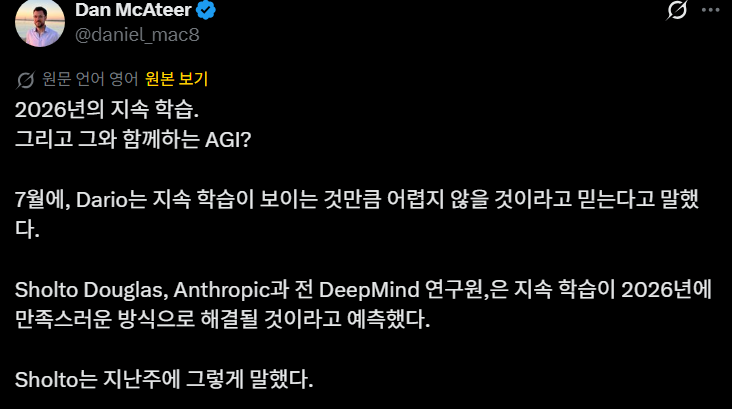

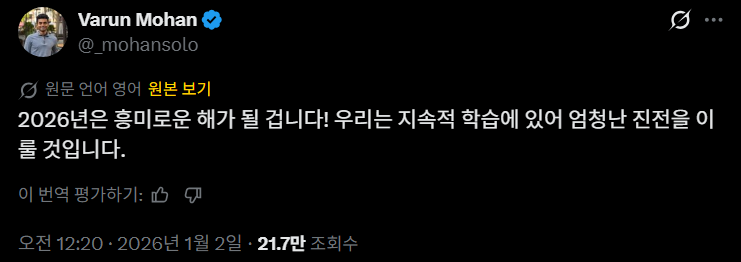

그래고 아래 올해 1월달에 구글, 딥마인드 연구원들이 '올해' 문자그대로 내년도 , 몇년후도아닌 올해 지속학습이 해결될거라며 매우 확신에차서 글을올림

(참고로 아래 인물들말고 딥마인드,구글 AI연구소쪽 인원 여럿이 이런트윗 올림 )

https://sub.strongai.kr/%ec%9e%90%ec%9c%a0%ea%b2%8c%ec%8b%9c%ed%8c%90-2/?pageid=3&mod=document&uid=3068

3. 딥마인드 연구원 2026 지속학습 해결 + 숄트 더글라스 (현 엔트로픽 , 전 딥마인드 출신)

(위 DAN은 연구원은아님 )

그리고 맨 아래 딥마인드 연구소 직원 트윗에 다른 구글 연구원 (동료) 가 댓글을 달았는대

4D체스 는 서구권에서 쓰는 표현인가본대

결국 저 댓글 (구글 연구원) 대로라면

딥마인드는 이미 내부적으로 엄청난 진전을 이뤘지만 (지속학습) , 대외적으로는 예언식으로 '2026년에 큰 진전이 있을 것'이라고 말하며 일종의 기만 을 하는게 아닌가 싶음

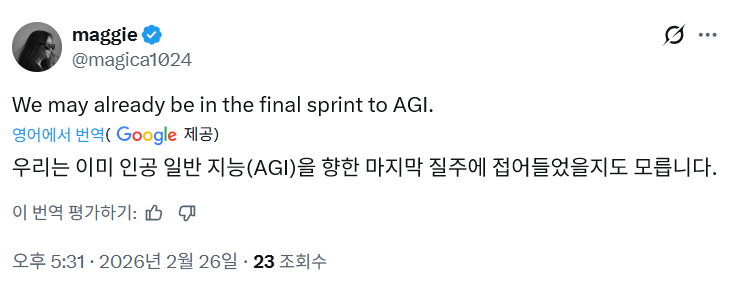

거기다가 오늘 올라온 딥마인드 연구원 트윗에서 (출처 : 관리자님 글)

하사비스 , 딥마인드쪽에서 이런말 나오는거보면 사실상 정말 마지막 단계에 접어든듯함.

엔트로픽쪽에서도 이전에 2027 재귀개선 , 데이터센터 천재들의 나라 예기하는거보면

전 글에서도 언급했듯이 하사비스 AGI 기준이 매우높기에 엔트로픽쪽에서 예기하는 ASI랑 다를바가 없다생각하는대 (재귀개선 루프 닫고 완전 자립하는 AGI)

결론 : 선형충들이 울부짖어도 기차는 달린다

ㄹㅇ 초지능님 오신다

이미 돌파구 찾아서 해결됐다는 거셈 크큭.?si=FMzaT88oB72fwjpS

어떻게알았셈??

사실 지속학습은 2024년에 해결되었다는 거셈!!! 크크큭

근데 그럴거같긴 하셈.. 사람들이 계속 무시하고 비웃지만 사실 대중에 공개되는거랑 내부에 있는 기술이랑 천지차이잖셈..

실제로 큐스타가 2023년도에 개발되어서 2024년 9월에 o1 모델로 한참 뒤에 발표된 거니까 지속학습도 방법론 자체는 2024년에 충분히 나올 수 있었을 것 같은데 기술이 적용되고 공식적으로 발표되기까지가 지연이 상당할 거셈

컄ㅋㅋㅋㅋㅋㅋㅋㅋㅋ

자기전에 기분 좋다

이제 슬슬 ai가 도구 레벨에서 벗어나서 경제적으로도 큰 성과를 내기 시작하면 좋겠다는 거셈